Seguro desde el inicio: El nuevo imperativo del desarrollo impulsado por la inteligencia artificial

Daniel Berman

La forma en que desarrollamos software ha cambiado de manera fundamental. Los asistentes de código con inteligencia artificial ya no son una novedad; se han convertido en el nuevo estándar e impulsan un salto revolucionario en la productividad y la innovación de los desarrolladores. Esto no forma parte de una tendencia a futuro, es la realidad de hoy. Debido a que aproximadamente la mitad de los equipos de desarrollo ya utilizan herramientas de inteligencia artificial generativa, y casi el 70 % de los líderes de ingeniería afirman que dedican menos tiempo a tareas técnicas, la era del desarrollo impulsado por la IA ya está aquí.

Sin embargo, esta aceleración conlleva un costo oculto: un desafío de seguridad en dos frentes que las herramientas tradicionales no fueron diseñadas para enfrentar. El primer frente es la nueva y acelerada amenaza del código no seguro generado por inteligencia artificial. Las investigaciones demuestran que casi la mitad del código generado por inteligencia artificial no es seguro, por lo que se está creando una enorme nueva superficie de ataque a una velocidad nunca antes vista. Este riesgo se ve amplificado por el nuevo paradigma del “vibe coding”, el auge de los desarrolladores no tradicionales y el hecho de que los modelos de inteligencia artificial suelen entrenarse con datos públicos defectuosos. Este nuevo desafío se ve agravado por el segundo frente: el enorme volumen actual de problemas de seguridad pendientes en el código escrito por humanos, que continúa ralentizando a los equipos.

Las herramientas de seguridad tradicionales están teniendo dificultades en ambos frentes. Son demasiado lentas para el nuevo flujo de trabajo basado en inteligencia artificial y carecen de la capacidad necesaria para eliminar de manera eficiente la deuda de seguridad acumulada del pasado. Esto deja a las organizaciones atrapadas entre ralentizar la innovación o aceptar un nivel de riesgo inaceptable.

Por qué el antiguo modelo de “Shift Left” (desplazamiento a la izquierda) ya no es suficiente.

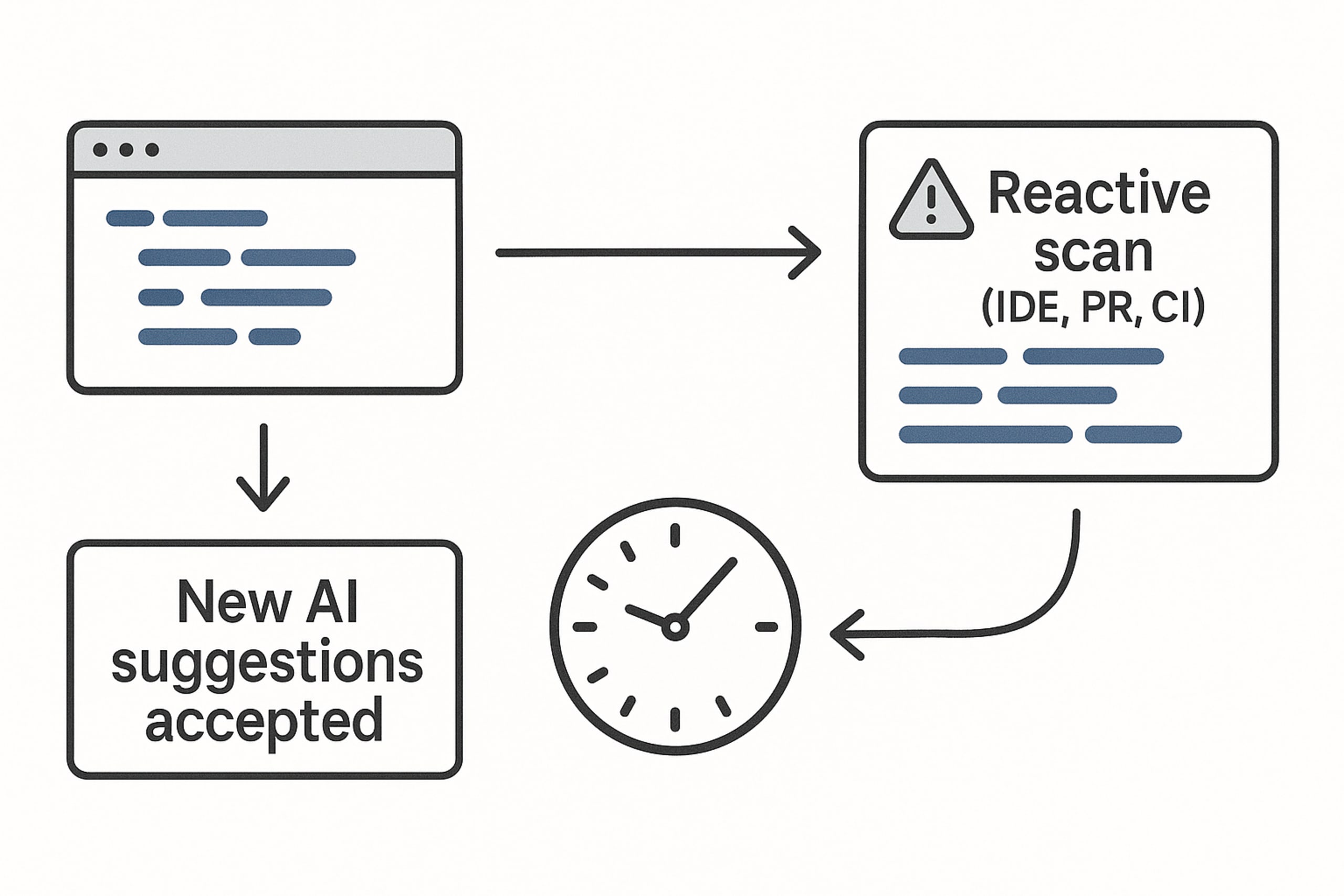

Durante años, la respuesta a los desafíos de la seguridad de las aplicaciones ha sido el enfoque de “shift left”, es decir, adelantar las pruebas para encontrar las vulnerabilidades de manera anticipada en el proceso de desarrollo. Si bien este principio sigue siendo importante, su aplicación tradicional, que depende de detectar vulnerabilidades dentro de los entornos de desarrollo (IDE), en las “pull requests” (solicitudes de cambios) o en las canalizaciones de integración y entrega continua (CI/CD), simplemente no puede mantenerse al ritmo del desarrollo asistido por inteligencia artificial.

Para cuando se ejecuta un análisis tradicional, el desarrollador puede haber aceptado ya decenas de sugerencias generadas por la inteligencia artificial, lo que convierte la remediación en una tarea costosa y disruptiva. Esta fricción resulta inaceptable para los desarrolladores que han adoptado la inteligencia artificial precisamente por su rapidez. Estas herramientas también son, por diseño, reactivas: detectan los problemas después de que el código ya se ha escrito. Carecen de la capacidad proactiva y formativa necesaria para guiar a la inteligencia artificial a generar código seguro desde el principio.

Esto genera un imperativo crucial para evolucionar hacia un nuevo paradigma.

La solución: Un nuevo paradigma: “Secure at Inception”

La respuesta no es frenar la innovación, sino integrar la seguridad directamente en el flujo de trabajo nativo de la inteligencia artificial. Este es el principio de “Secure at Inception”: un nuevo enfoque que va más allá del análisis reactivo y guía proactivamente al asistente de codificación con IA para generar código seguro desde la primera instrucción. Se trata de convertir la seguridad en una parte invisible y automática del proceso de creación.

Snyk Studio es el único producto de seguridad diseñado con un enfoque centrado en el desarrollador y creado para esta nueva realidad. Abordamos ambos frentes del desafío de seguridad en el desarrollo con una solución única y unificada.

Para afrontar la nueva frontera del código generado por IA, Snyk Studio te ayuda a aplicar el enfoque “Secure at Inception” mediante la integración de nuestros motores de seguridad líderes en el mercado directamente en el asistente de IA del desarrollador. No nos limitamos a analizar el código que genera la IA; inyectamos el escaneo de seguridad y la remediación directamente en el flujo del asistente de codificación, lo que asegura el código desde la primera instrucción.

Para abordar la deuda de seguridad acumulada, Snyk Studio ofrece “Intelligent Remediation”, que utiliza la potencia de la inteligencia artificial para eliminar los atrasos a una escala y velocidad antes inimaginables, lo que libera a tus desarrolladores para que se concentren en el futuro.

La seguridad del desarrollo impulsado por inteligencia artificial en la práctica

Prevención de problemas en el código propio

Imagina a un desarrollador en una empresa de tecnología sanitaria que está creando una función para visualizar las historias clínicas de los pacientes. Recurre al asistente de código con inteligencia artificial y escribe una instrucción: “Crea un endpoint de API que obtenga una historia clínica de un paciente por su ID desde la base de datos”.

La IA, centrada únicamente en la funcionalidad, genera al instante una función limpia y eficiente que toma un recordId de la URL y recupera el registro correspondiente. Sin embargo, esta versión inicial del código contiene una vulnerabilidad crítica de Referencia Directa Insegura a Objetos (IDOR), ya que nunca verifica si el usuario autenticado está autorizado a ver ese registro en particular.

Un escaneo de seguridad tradicional debería detectar este problema, idealmente dentro del IDE o en la solicitud de cambios. Sin embargo, esto depende de que el desarrollador ejecute un escaneo SAST, el cual con demasiada frecuencia resulta demasiado lento y disruptivo.

Pero con el enfoque “Secure at Inception” de Snyk Studio, el proceso es diferente. Existe una regla incorporada directamente en el asistente de código con IA: “Para cualquier nuevo código generado, ejecuta inmediatamente un análisis de Snyk Code. Si se detectan problemas, intenta corregirlos utilizando los resultados y vuelve a ejecutar el análisis para verificarlos”.

Siguiendo esta regla, el asistente de IA no se detiene después de generar el primer borrador. Ejecuta inmediatamente Snyk Code sobre la función recién creada. El motor de Snyk detecta al instante la vulnerabilidad de IDOR y proporciona el contexto necesario. Con esta información, el asistente de IA genera de forma autónoma la corrección correspondiente y añade la lógica esencial para validar que el ownerId del registro coincida con el userId de la sesión autenticada. Luego, vuelve a ejecutar el escaneo del código, y Snyk confirma que la vulnerabilidad se ha eliminado.

El desarrollador recibe así un código final, seguro y validado, desde la primera instrucción. Esta es la fuerza de un mecanismo de seguridad basado en procesos: la seguridad se convierte en una parte automatizada e invisible del propio proceso de creación.

Cómo evitar vulnerabilidades en un código abierto

El principio de prevención proactiva resulta aún más crucial en el caso de las dependencias de código abierto que los asistentes de IA suelen recomendar. El riesgo aquí no se limita a vulnerabilidades accidentales en versiones antiguas de paquetes. Como han demostrado los recientes ataques a la cadena de suministro, existe una amenaza creciente de código malicioso insertado intencionadamente en paquetes populares.

Un asistente de IA, entrenado con grandes volúmenes de datos públicos, puede sin saberlo recomendar estas dependencias comprometidas y, de esta forma, introducir amenazas activas directamente en el código base.

Imagina que un segundo desarrollador le pide a su asistente de IA: “Crea un nuevo endpoint de API con Express que gestione un proceso de compra”.

La IA podría generar un endpoint perfectamente funcional que utilice el paquete de código abierto qs@6.5.1 para analizar la entrada del usuario. Sin embargo, esta versión de la biblioteca qs contiene una vulnerabilidad conocida de contaminación de prototipos de alta gravedad, que podría permitir a un atacante modificar el comportamiento de la aplicación e incluso provocar el bloqueo del servidor.

Una vez más, un escaneo de seguridad tradicional podría detectar esta vulnerabilidad en el IDE o más adelante, durante la revisión del PR; pero aun así obligaría al desarrollador a interrumpir su trabajo, cambiar de contexto y buscar una alternativa segura.

Con “Secure at Inception”, el flujo de trabajo es diferente. El equipo de seguridad ha utilizado Snyk para establecer una regla sencilla a fin de detectar y corregir cualquier versión de dependencia vulnerable recién introducida o modificada. Ahora, cuando el desarrollador ingresa la misma instrucción, la IA, impulsada por la inteligencia de seguridad de Snyk, sabe que debe evitar la versión no segura del paquete en el código final que presenta al desarrollador. Genera el mismo endpoint funcional de API, pero se asegura de usar la versión más reciente y corregida de la biblioteca qs.

No hay alertas, ni fricción, ni cambio de contexto. Esta es la fuerza de la prevención proactiva: la seguridad se convierte en un facilitador invisible, no en una barrera disruptiva.

Eliminar el atraso

El enfoque “Secure at Inception” es fundamental para prevenir nuevas vulnerabilidades, pero ¿qué pasa con el enorme atraso de seguridad que la mayoría de las organizaciones ya arrastran?

En Labelbox, una factoría de datos para inteligencia artificial generativa, un solo ingeniero de seguridad, Aaron Bacchi, enfrentaba un atraso de dos años de problemas de SAST de alta gravedad. Con el equipo de desarrollo enfocado en lanzar nuevas funcionalidades, este atraso representaba una fuente constante de riesgo que simplemente no tenían la capacidad de abordar.

Al combinar su asistente de código con IA, Cursor, con Snyk Studio, Aaron creó un flujo de trabajo de remediación impulsado por IA. Utilizó el asistente de IA, guiado por el contexto de seguridad de Snyk, para validar, probar y generar correcciones para las vulnerabilidades pendientes.

El resultado fue transformador. Logró resolver todo el atraso de dos años de problemas de SAST de alta gravedad en solo unas pocas semanas. Esto no solo eliminó una gran cantidad de riesgo, sino que además le permitió concentrarse en iniciativas de seguridad más estratégicas, sin quitar tiempo al equipo principal de ingeniería. Como señaló el propio Aaron: “Esto fue transformador. Por primera vez, siento que realmente puedo llegar a cero”.

Del riesgo de la IA a la innovación segura

La era del desarrollo impulsado por inteligencia artificial ya está aquí. Para prosperar, las organizaciones deben ir más allá de las medidas de seguridad improvisadas y adoptar un programa escalable, gestionable y seguro por defecto. Los antiguos modelos de análisis reactivo, realizado después del hecho, ya no son suficientes para la velocidad y la escala que exige la IA.

Al adoptar la metodología “Secure at Inception”, es posible prevenir de forma proactiva las nuevas vulnerabilidades generadas por la IA. Y mediante el uso de “Intelligent Remediation”, se puede eliminar eficazmente la deuda de seguridad del pasado. Snyk Studio ofrece una solución completa, centrada en el desarrollador, que permite hacer ambas cosas: abrazar con confianza el futuro del desarrollo de software y convertir la promesa de velocidad impulsada por la IA en una realidad segura.

¡Comienza a usar Secure at Inception en solo unos pocos clics!

Innova con IA. De forma segura.

Obtén más información sobre cómo Snyk Studio te ayuda a proteger el flujo de trabajo de desarrollo impulsado por inteligencia artificial.